Dit is hoe het naaktheidsalgoritme werd geboren. Wat betreft de website? Zie het minder als een salontruc en meer als een marketingtool. Als seks verkoopt, zal het filteren dat misschien ook doen.

“We dachten dat er potentieel een veel bredere toepasbaarheid zou zijn”, zegt Daniel. “Iedereen die een community probeert te runnen, maar aanstootgevende inhoud wil filteren of deze kindvriendelijk wil houden, kan profiteren van hetzelfde algoritme. » Gezien de aard van de inhoud bewaart of bekijkt Algorithmia uw afbeeldingen niet; de site roept eenvoudigweg het algoritme voor naaktheidsdetectie aan en retourneert een resultaat.

Door dit te doen, helpen bijdragen aan isitnude.com zijn detectievermogen te verfijnen. Deze vooruitgang zal echter fragmentarisch zijn; Privacynormen die voorkomen dat Algorithmia jouw foto’s kan bekijken, betekenen ook dat potentieel nuttige resultaten via andere kanalen moeten worden gerapporteerd. “Mensen stuurden ons e-mails en tweets waarin ze ons vertelden dat een foto niet echt werkte”, legt Daniel uit. “We gebruikten het om te herhalen. »

Er zal ook meer nodig zijn dan een simpele aanpassing voordat het algoritme onfeilbaar wordt, of zelfs een beetje bruin wordt. Het kan bijvoorbeeld nog geen individuele lichaamsdelen herkennen, wat betekent dat een afbeelding van iemand die volledig gekleed is, met uitzondering van de delen die je het liefst aangekleed wilt hebben, waarschijnlijk nog steeds doorkomt. En omdat het uitsluitend op vlees is gebaseerd, kunnen anders onschuldige strandfoto's worden gemarkeerd. Een nog grotere storing? Omdat het algoritme afhankelijk is van huidskleurherkenning, staat het machteloos tegen zwart-witbeelden.

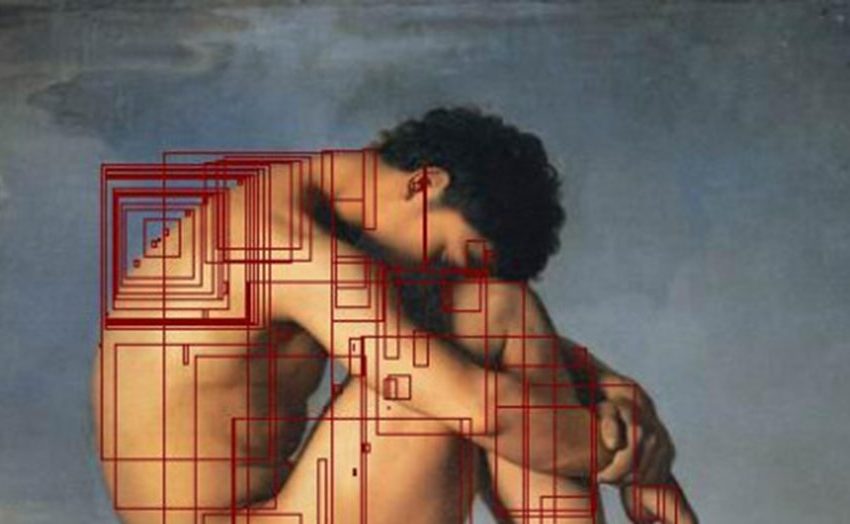

Er is ook het bredere probleem van het beperkte bereik, zelfs als het perfect werkt. Er bestaat een heel universum van potentieel aanstootgevende, op afbeeldingen gebaseerde inhoud die niets met skin te maken heeft, zegt Joshua Buxbaum, mede-oprichter van WebPurifier, een dienst voor inhoudsmoderatie. ‘Geweld’, geeft Buxbaum het voorbeeld, ‘is ingewikkeld. We krijgen zelfs details zo gedetailleerd mogelijk. » geweld in een sport die geen gewelddadige sport is het is geweld, maar als het boksen is, wie dan? is een gewelddadige sport, we staan het toe. Dit is nog maar een begin; Volgens Buxbaum zou een echt alomvattend pakket voor beeldmoderatie potentieel alles moeten corrigeren, van haatmisdrijven tot drugsparafernalia tot grove gebaren, afhankelijk van de behoeften van de cliënt, en de grijze gebieden binnen elk van deze categorieën aanpakken. De oplossing van Algorithmia zoekt alleen naar naakte mensen en zelfs dan heeft het nog steeds de lastige taak om te bepalen of ze onzedelijk zijn of niet. Buxbaum stelt dat het eenvoudigste algoritme iets zou kunnen filteren op godslastering, maar het zou moeite hebben om haatzaaiende uitlatingen of pesten te identificeren – wat betekent dat een algoritme voor naaktheidsdetectie vlees zou kunnen vinden, maar moeite zou hebben om te onderscheiden of het wraakporno of kunstwerken is.

Dit maakt het algoritme voor naaktheidsdetectie echter niet onbruikbaar; het is eerder een bot instrument dan een preutse lasergeleide raket. Daniel verwacht ook dat dit soort problemen in de loop van de tijd zullen worden opgelost, vooral als er duidelijke zakelijke belangen zijn. “We zullen het blijven verbeteren”, zegt hij, “en als een gebruiker van ons systeem wil binnenkomen en een geavanceerder algoritme voor naaktheidsdetectie wil creëren, kan hij of zij dat ook doen. » Als een van Algorithmia's partners erin zou slagen een betere code te kraken, zou hij of zij betaald worden volgens een model dat rechtstreeks uit de Apple App Store geleend werd; ontvang een vergoeding voor elke algoritmeoproep, waarbij Algorithmia 30% van het bedrag voor zijn rekening neemt.