这就是其裸体算法的诞生。至于网站?与其将其视为一种客厅技巧,不如将其视为一种营销工具。如果性可以卖,也许过滤也可以。

“我们认为这可能会有更广泛的适用性,”丹尼尔说。 “任何试图运营社区但想要过滤令人反感的内容或保持其对儿童友好的人都可以从同样的算法中受益。 » 鉴于内容的性质,Algorithmia 不会存储或查看您的图像;该网站只是调用裸体检测算法并返回结果。

在此过程中,对 isitnude.com 的贡献有助于提高其检测能力。然而,这一进展将是碎片化的;阻止 Algorithmia 查看您的照片的隐私标准也意味着必须通过其他渠道报告潜在有用的结果。 “人们给我们发电子邮件、推文,告诉我们照片实际上不起作用,”丹尼尔解释道。 “我们用它来迭代。 »

要使算法变得万无一失,甚至稍微晒黑,还需要不仅仅是简单的调整。例如,它还无法识别身体的各个部位,这意味着除了你最想打扮的部分之外,一个穿着全套衣服的人的图像可能仍然会穿过。而且因为它仅基于肉体,否则无辜的海滩照片最终可能会被标记。更大的问题?由于该算法依赖于肤色识别,因此对于黑白图像无能为力。

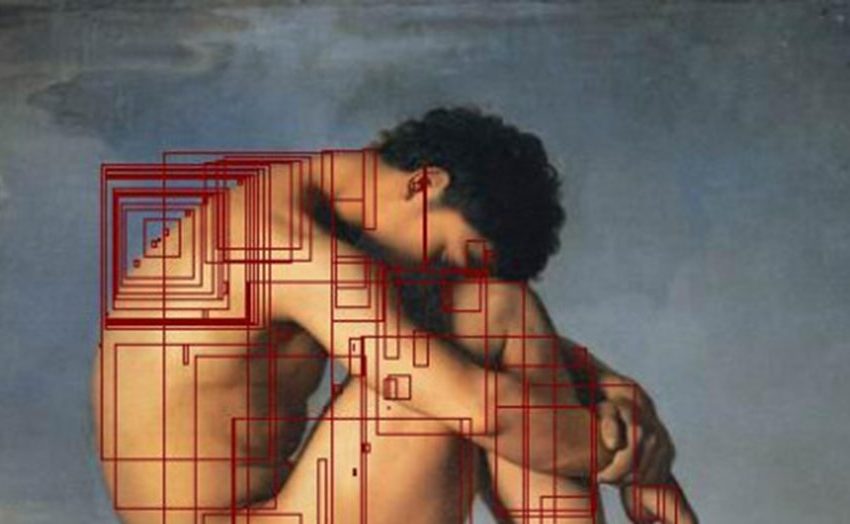

还有一个更广泛的问题,即即使它运行完美,它的影响范围也有限。该公司的联合创始人约书亚·布克斯鲍姆 (Joshua Buxbaum) 表示,存在大量潜在的令人反感的基于图像的内容,但与皮肤无关。 网页净化器,内容审核服务。布克斯鲍姆举例说,“暴力很复杂。我们甚至获得尽可能详细的细节。 » 非暴力运动中的暴力 这是暴力,但如果是拳击,谁 是 这是一项暴力运动,我们允许它。这只是开始;根据布克斯鲍姆的说法,一个真正全面的图像审核套件应该可以根据客户的需求纠正从仇恨犯罪到毒品用具到粗俗手势的所有内容,并解决每个类别中的灰色区域。 Algorithmia 的解决方案只寻找裸体的人,即便如此,它仍然面临着确定他们是否淫荡的艰巨任务。布克斯鲍姆提出,最简单的算法可以过滤掉一些脏话,但它很难识别仇恨言论或欺凌行为——这意味着裸体检测算法可以找到肉体,但很难区分它是复仇色情还是艺术作品。

然而,这并不意味着其裸体检测算法毫无用处。它只是一个钝器而不是正经的激光制导导弹。丹尼尔还预计这些类型的问题将随着时间的推移得到解决,特别是如果有明确的商业利益的话。 “我们将继续改进它,”他说,“或者如果我们系统的用户想要进来并尝试创建更复杂的裸体检测算法,他们也可以这样做。 » 如果 Algorithmia 的合作伙伴之一成功破解了更好的代码,他们将根据直接从 Apple App Store 借用的模型获得报酬;每次调用算法都会收取费用,其中 Algorithmia 收取总金额的 30%。